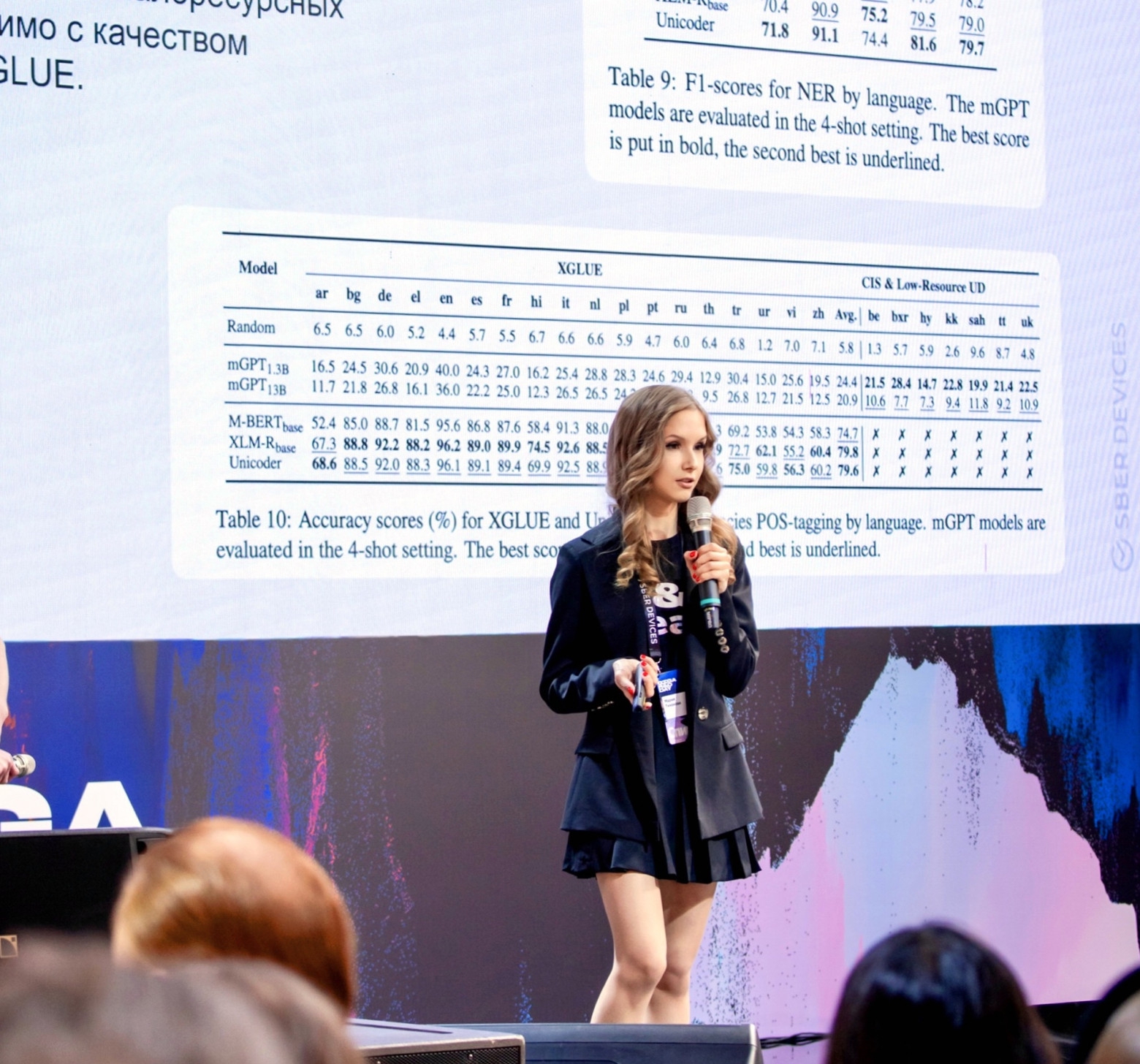

Я студентка матфакультета, специализируюсь на прикладной математике и работаю в data science. В посл

Аноним

# OP

16/04/25 Срд 16:16:03

№

1